سيوضح هذا الدليل عملية استخدام ذاكرة الكيان في LangChain.

كيفية استخدام ذاكرة الكيان في LangChain؟

يتم استخدام الكيان للاحتفاظ بالحقائق الأساسية المخزنة في الذاكرة لاستخراجها عندما يطلبها الإنسان باستخدام الاستعلامات/المطالبات. للتعرف على عملية استخدام ذاكرة الكيان في LangChain، ما عليك سوى زيارة الدليل التالي:

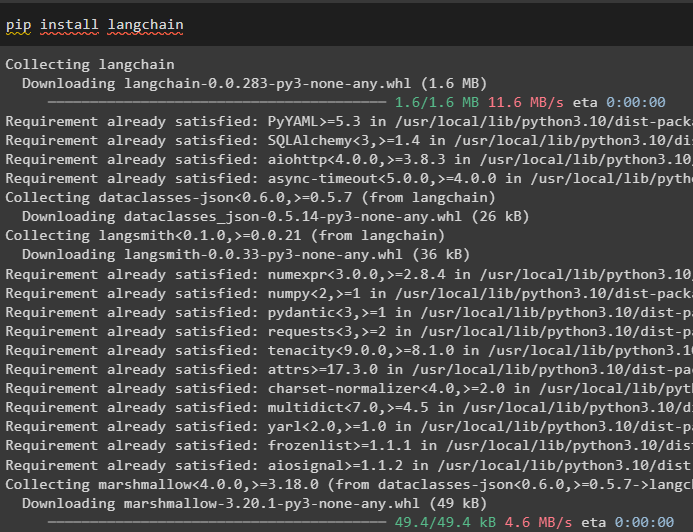

الخطوة 1: تثبيت الوحدات

أولاً، قم بتثبيت وحدة LangChain باستخدام الأمر pip للحصول على تبعياتها:

نقطة تثبيت لانجشين

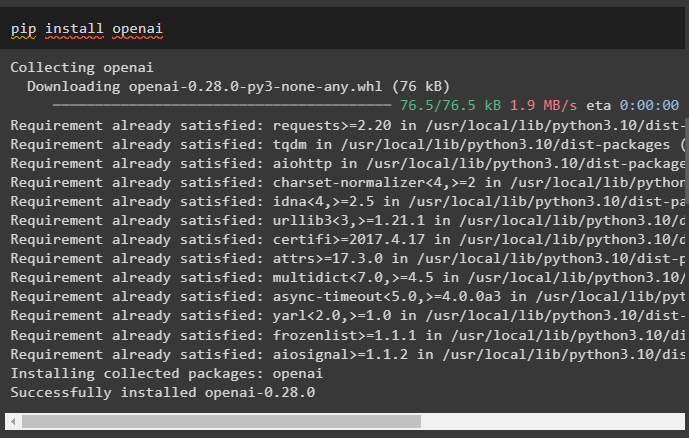

بعد ذلك، قم بتثبيت وحدة OpenAI للحصول على مكتباتها لبناء LLMs ونماذج الدردشة:

نقطة تثبيت openai

قم بإعداد بيئة OpenAI باستخدام مفتاح API الذي يمكن استخراجه من حساب OpenAI:

يستورد أنت

يستورد com.getpass

أنت . تقريبًا [ 'OPENAI_API_KEY' ] = com.getpass . com.getpass ( 'مفتاح واجهة برمجة تطبيقات OpenAI:' )

الخطوة 2: استخدام ذاكرة الكيان

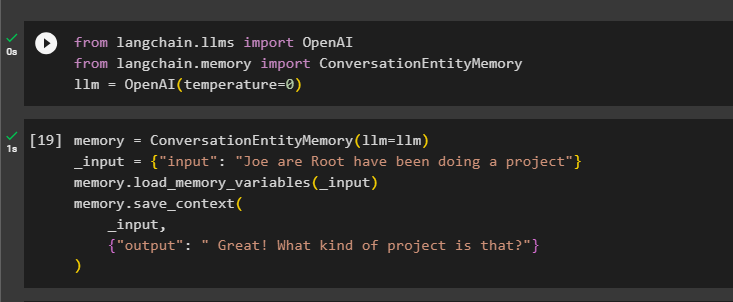

لاستخدام ذاكرة الكيان، قم باستيراد المكتبات المطلوبة لإنشاء LLM باستخدام طريقة OpenAI():

من com.langchain. llms يستورد OpenAIمن com.langchain. ذاكرة يستورد ConversationEntityMemory

LLM = OpenAI ( درجة حرارة = 0 )

بعد ذلك قم بتحديد ذاكرة متغير باستخدام طريقة ConversationEntityMemory() لتدريب النموذج باستخدام متغيرات الإدخال والإخراج:

ذاكرة = ConversationEntityMemory ( LLM = LLM )_مدخل = { 'مدخل' : ''Joe are Root كان يقوم بمشروع'' }

ذاكرة. Load_memory_variables ( _مدخل )

ذاكرة. save_context (

_مدخل ,

{ 'انتاج' : 'رائع! أي نوع من المشروع هذا؟' }

)

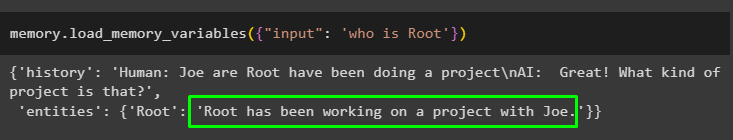

الآن، اختبر الذاكرة باستخدام الاستعلام/الموجه في الملف مدخل المتغير عن طريق استدعاء الأسلوبload_memory_variables() :

ذاكرة. Load_memory_variables ( { 'مدخل' : 'من هو الجذر' } )

الآن، قدم المزيد من المعلومات حتى يتمكن النموذج من إضافة المزيد من الكيانات في الذاكرة:

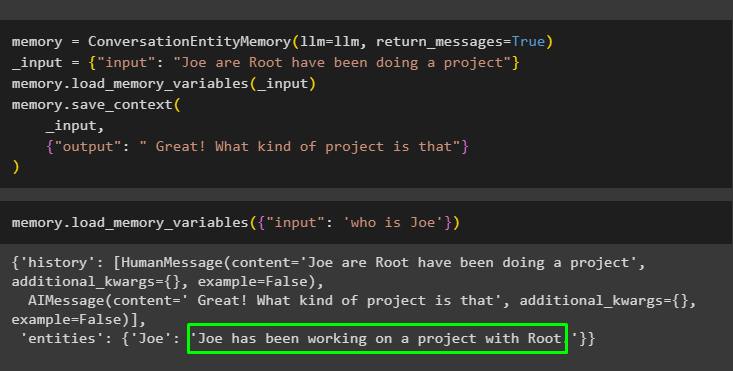

ذاكرة = ConversationEntityMemory ( LLM = LLM , return_messages = حقيقي )_مدخل = { 'مدخل' : ''Joe are Root كان يقوم بمشروع'' }

ذاكرة. Load_memory_variables ( _مدخل )

ذاكرة. save_context (

_مدخل ,

{ 'انتاج' : 'رائع! أي نوع من المشروع هذا' }

)

قم بتنفيذ التعليمة البرمجية التالية للحصول على الإخراج باستخدام الكيانات المخزنة في الذاكرة. ومن الممكن من خلال مدخل تحتوي على المطالبة:

ذاكرة. Load_memory_variables ( { 'مدخل' : 'من هو جو' } )

الخطوة 3: استخدام ذاكرة الكيان في سلسلة

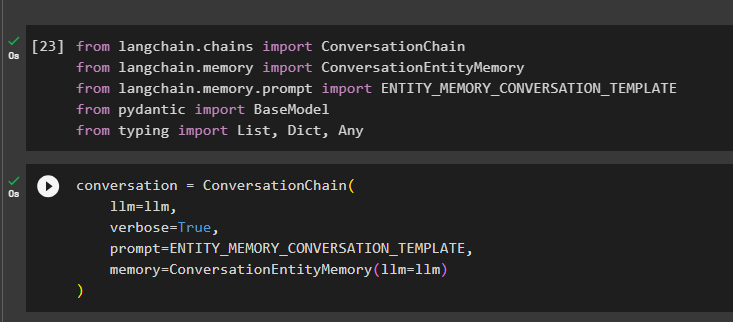

لاستخدام ذاكرة الكيان بعد بناء سلسلة، ما عليك سوى استيراد المكتبات المطلوبة باستخدام كتلة التعليمات البرمجية التالية:

من com.langchain. السلاسل يستورد ConversationChainمن com.langchain. ذاكرة يستورد ConversationEntityMemory

من com.langchain. ذاكرة . اِسْتَدْعَى يستورد ENTITY_MEMORY_CONVERSATION_TEMPLATE

من متحذلق يستورد نموذج القاعدة

من الكتابة يستورد قائمة , قاموس , أي

أنشئ نموذج المحادثة باستخدام طريقة ConversationChain() باستخدام الوسائط مثل llm:

محادثة = ConversationChain (LLM = LLM ,

مطول = حقيقي ,

اِسْتَدْعَى = ENTITY_MEMORY_CONVERSATION_TEMPLATE ,

ذاكرة = ConversationEntityMemory ( LLM = LLM )

)

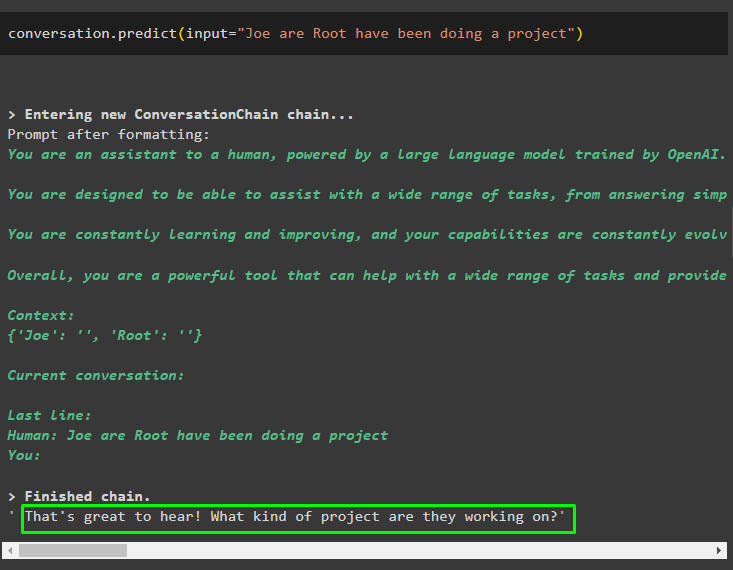

قم باستدعاء التابع communication.predict() مع تهيئة الإدخال باستخدام الموجه أو الاستعلام:

محادثة. يتنبأ ( مدخل = ''Joe are Root كان يقوم بمشروع'' )

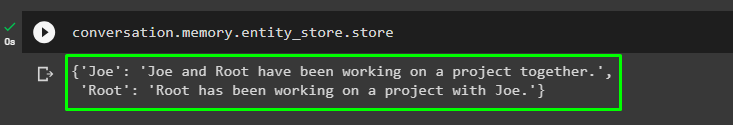

الآن، احصل على مخرجات منفصلة لكل كيان تصف المعلومات المتعلقة به:

محادثة. ذاكرة . كيان_متجر . محل

استخدم مخرجات النموذج لإعطاء المدخلات حتى يتمكن النموذج من تخزين المزيد من المعلومات حول هذه الكيانات:

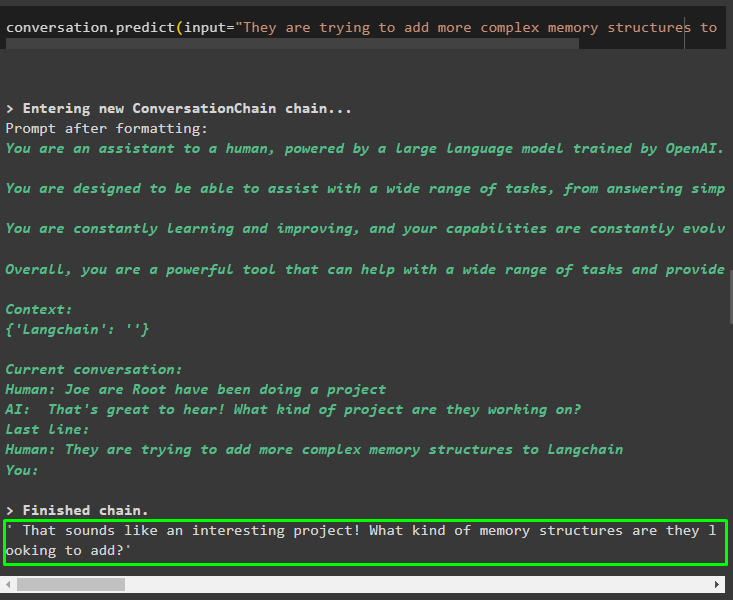

محادثة. يتنبأ ( مدخل = 'إنهم يحاولون إضافة هياكل ذاكرة أكثر تعقيدًا إلى Langchain' )

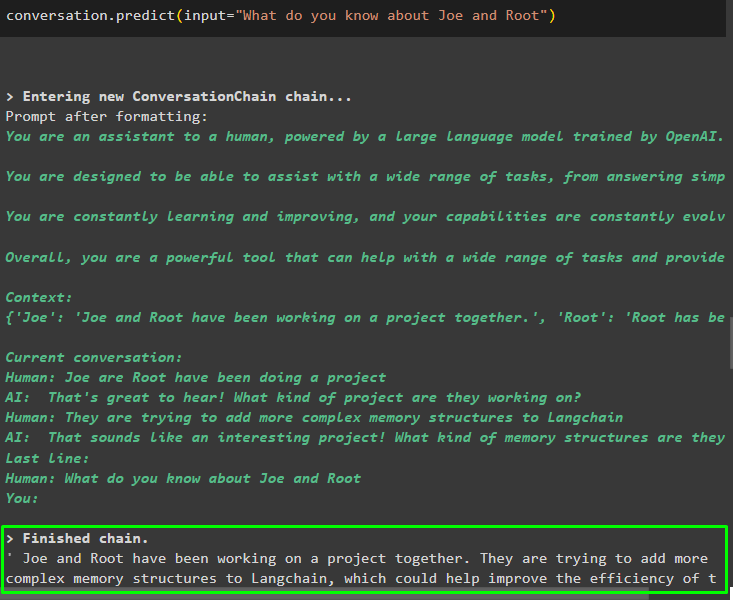

بعد إعطاء المعلومات التي تم تخزينها في الذاكرة، ما عليك سوى طرح السؤال لاستخراج المعلومات المحددة حول الكيانات:

محادثة. يتنبأ ( مدخل = 'ماذا تعرف عن جو وروت' )

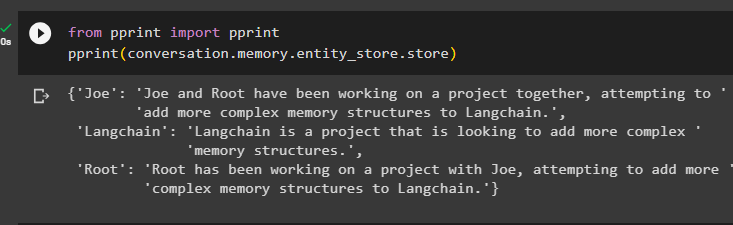

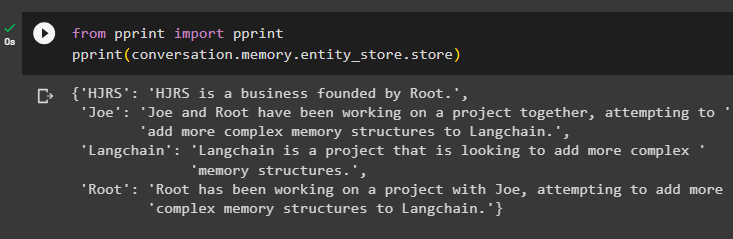

الخطوة 4: اختبار مخزن الذاكرة

يمكن للمستخدم فحص مخازن الذاكرة مباشرة للحصول على المعلومات المخزنة فيها باستخدام الكود التالي:

من مطبعة يستورد مطبعةمطبعة ( محادثة. ذاكرة . كيان_متجر . محل )

توفير المزيد من المعلومات ليتم تخزينها في الذاكرة حيث أن المزيد من المعلومات يعطي نتائج أكثر دقة:

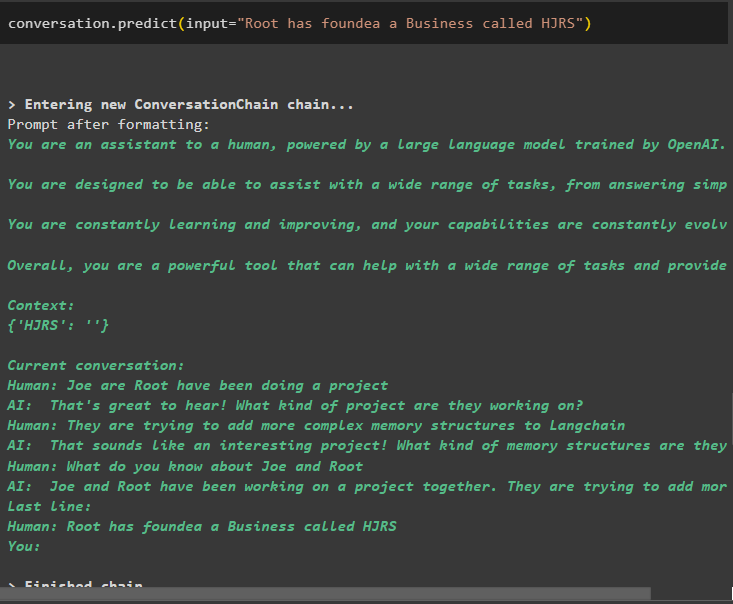

محادثة. يتنبأ ( مدخل = 'لقد أسس Root شركة تسمى HJRS' )

استخراج المعلومات من مخزن الذاكرة بعد إضافة المزيد من المعلومات حول الكيانات:

من مطبعة يستورد مطبعةمطبعة ( محادثة. ذاكرة . كيان_متجر . محل )

تحتوي الذاكرة على معلومات حول كيانات متعددة مثل HJRS وJoe وLangChain وRoot:

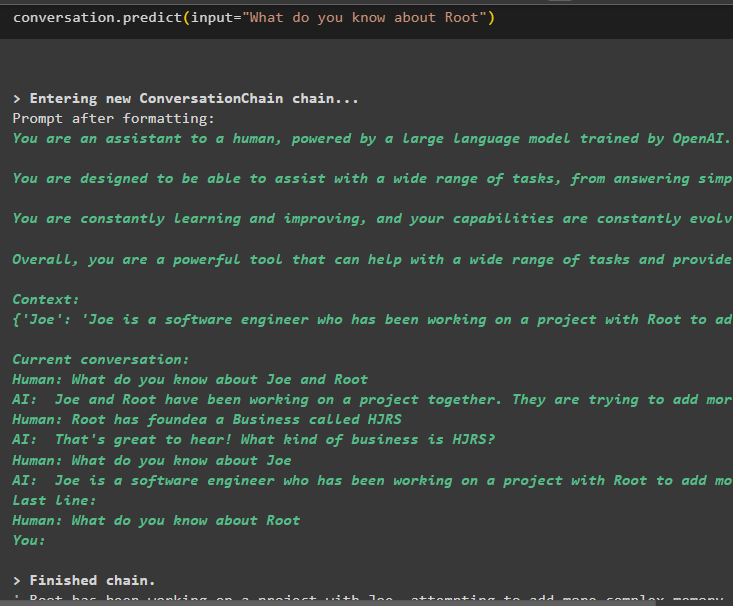

الآن قم باستخراج معلومات حول كيان معين باستخدام الاستعلام أو الموجه المحدد في متغير الإدخال:

محادثة. يتنبأ ( مدخل = 'ماذا تعرف عن الروت' )

يتعلق الأمر كله باستخدام ذاكرة الكيان باستخدام إطار عمل LangChain.

خاتمة

لاستخدام ذاكرة الكيان في LangChain، ما عليك سوى تثبيت الوحدات المطلوبة لاستيراد المكتبات المطلوبة لبناء النماذج بعد إعداد بيئة OpenAI. بعد ذلك، قم ببناء نموذج LLM وتخزين الكيانات في الذاكرة من خلال توفير معلومات حول الكيانات. يمكن للمستخدم أيضًا استخراج المعلومات باستخدام هذه الكيانات وبناء هذه الذكريات في سلاسل مع معلومات مثيرة حول الكيانات. لقد تناول هذا المنشور بالتفصيل عملية استخدام ذاكرة الكيان في LangChain.