كيفية استخدام نافذة المخزن المؤقت للمحادثة في LangChain؟

يتم استخدام نافذة المخزن المؤقت للمحادثة للاحتفاظ بأحدث رسائل المحادثة في الذاكرة للحصول على السياق الأحدث. يستخدم قيمة K لتخزين الرسائل أو السلاسل في الذاكرة باستخدام إطار عمل LangChain.

للتعرف على عملية استخدام نافذة المخزن المؤقت للمحادثة في LangChain، ما عليك سوى الاطلاع على الدليل التالي:

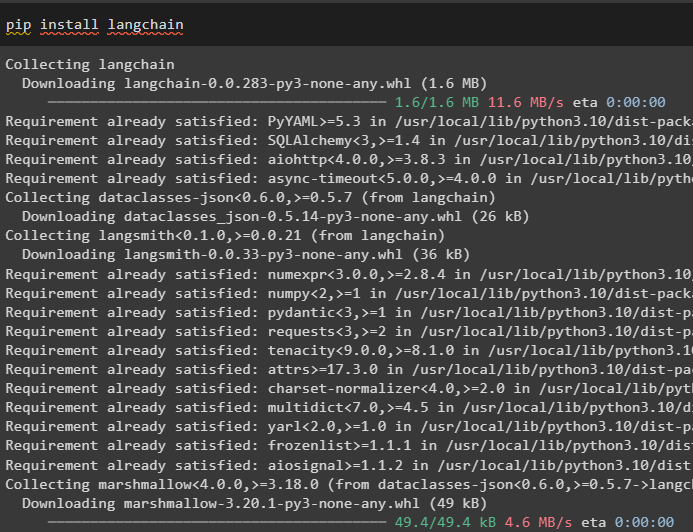

الخطوة 1: تثبيت الوحدات

ابدأ عملية استخدام نافذة المخزن المؤقت للمحادثة عن طريق تثبيت وحدة LangChain مع التبعيات المطلوبة لبناء نماذج المحادثة:

نقطة تثبيت لانجشين

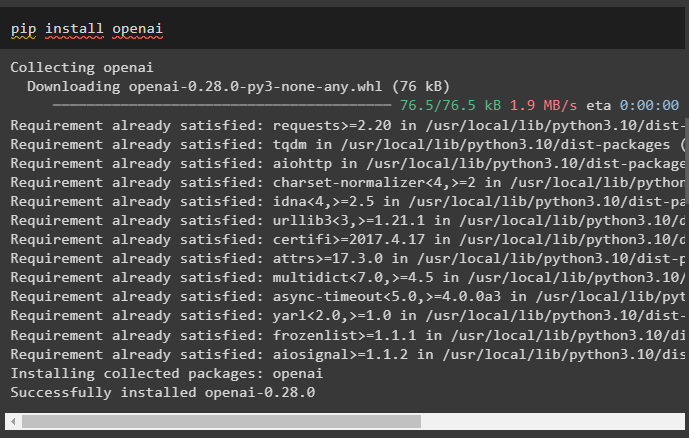

بعد ذلك، قم بتثبيت وحدة OpenAI التي يمكن استخدامها لبناء نماذج اللغات الكبيرة في LangChain:

نقطة تثبيت openai

الآن، قم بإعداد بيئة OpenAI لإنشاء سلاسل LLM باستخدام مفتاح API من حساب OpenAI:

يستورد أنت

يستورد com.getpass

أنت . تقريبًا [ 'OPENAI_API_KEY' ] = com.getpass . com.getpass ( 'مفتاح واجهة برمجة تطبيقات OpenAI:' )

الخطوة 2: استخدام ذاكرة نافذة المخزن المؤقت للمحادثة

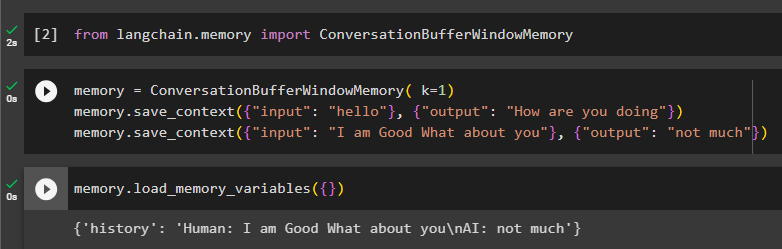

لاستخدام ذاكرة نافذة المخزن المؤقت للمحادثة في LangChain، قم باستيراد ملف ConversationBufferWindowMemory مكتبة:

من com.langchain. ذاكرة يستورد ConversationBufferWindowMemoryقم بتكوين الذاكرة باستخدام ConversationBufferWindowMemory () مع قيمة k كوسيطة لها. سيتم استخدام قيمة k للاحتفاظ بأحدث الرسائل من المحادثة ثم تكوين بيانات التدريب باستخدام متغيرات الإدخال والإخراج:

ذاكرة = ConversationBufferWindowMemory ( ك = 1 )ذاكرة. save_context ( { 'مدخل' : 'مرحبًا' } , { 'انتاج' : 'كيف حالك' } )

ذاكرة. save_context ( { 'مدخل' : 'أنا بخير ماذا عنك' } , { 'انتاج' : 'ليس كثيراً' } )

اختبر الذاكرة عن طريق الاتصال بالرقم Load_memory_variables () طريقة بدء المحادثة:

ذاكرة. Load_memory_variables ( { } )

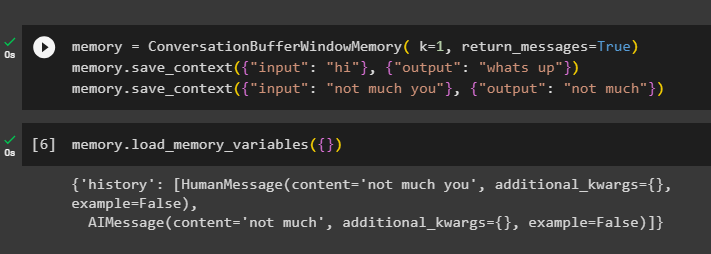

للحصول على سجل المحادثة، قم بتكوين وظيفة ConversationBufferWindowMemory() باستخدام التابع return_messages دعوى:

ذاكرة = ConversationBufferWindowMemory ( ك = 1 , return_messages = حقيقي )ذاكرة. save_context ( { 'مدخل' : 'أهلاً' } , { 'انتاج' : 'ما أخبارك' } )

ذاكرة. save_context ( { 'مدخل' : 'ليس كثيرا لك' } , { 'انتاج' : 'ليس كثيراً' } )

الآن، اتصل بالذاكرة باستخدام الأمر Load_memory_variables () طريقة الحصول على الرد مع تاريخ المحادثة :

ذاكرة. Load_memory_variables ( { } )

الخطوة 3: استخدام نافذة المخزن المؤقت في سلسلة

بناء السلسلة باستخدام OpenAI و ConversationChain المكتبات ثم قم بتكوين الذاكرة المؤقتة لتخزين أحدث الرسائل في المحادثة:

من com.langchain. السلاسل يستورد ConversationChainمن com.langchain. llms يستورد OpenAI

# بناء ملخص المحادثة باستخدام معلمات متعددة

المحادثة_مع_الملخص = ConversationChain (

LLM = OpenAI ( درجة حرارة = 0 ) ,

# بناء مخزن مؤقت للذاكرة باستخدام وظيفته بقيمة k لتخزين الرسائل الحديثة

ذاكرة = ConversationBufferWindowMemory ( ك = 2 ) ,

#configure المتغير المطول للحصول على مخرجات أكثر قابلية للقراءة

مطول = حقيقي

)

المحادثة_مع_الملخص. يتنبأ ( مدخل = 'مرحبا ما الاخبار' )

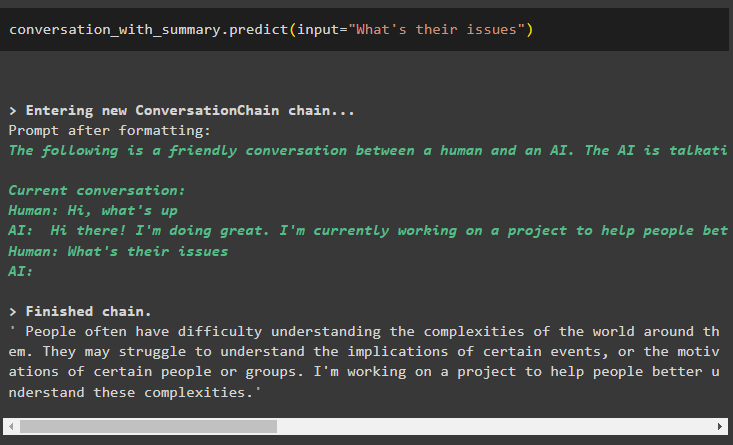

الآن، استمر في المحادثة من خلال طرح السؤال المتعلق بالمخرجات التي يقدمها النموذج:

المحادثة_مع_الملخص. يتنبأ ( مدخل = 'ما هي قضاياهم' )

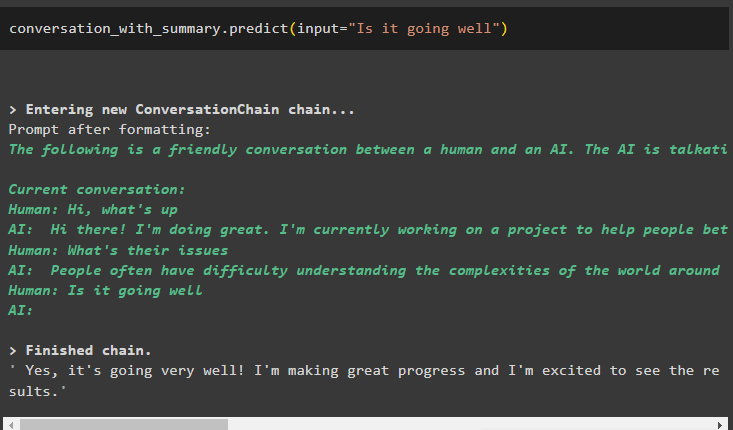

تم تكوين النموذج لتخزين رسالة سابقة واحدة فقط والتي يمكن استخدامها كسياق:

المحادثة_مع_الملخص. يتنبأ ( مدخل = 'تسير الأمور بشكل جيد' )

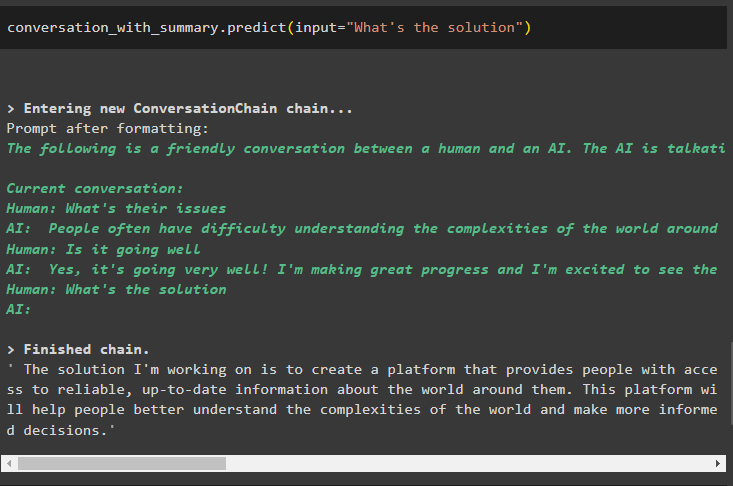

اطلب حل المشكلات وسيستمر هيكل الإخراج في تحريك النافذة العازلة عن طريق إزالة الرسائل السابقة:

المحادثة_مع_الملخص. يتنبأ ( مدخل = 'ما هو الحل' )

هذا هو كل ما يتعلق بعملية استخدام نوافذ المخزن المؤقت للمحادثة LangChain.

خاتمة

لاستخدام ذاكرة نافذة المخزن المؤقت للمحادثة في LangChain، ما عليك سوى تثبيت الوحدات وإعداد البيئة باستخدام مفتاح API الخاص بـ OpenAI. بعد ذلك، قم ببناء الذاكرة المؤقتة باستخدام قيمة k للاحتفاظ بأحدث الرسائل في المحادثة للحفاظ على السياق. يمكن أيضًا استخدام الذاكرة المؤقتة مع السلاسل لتحفيز المحادثة مع LLM أو السلسلة. لقد تناول هذا الدليل بالتفصيل عملية استخدام نافذة المخزن المؤقت للمحادثة في LangChain.